“수천억 원짜리 거대 모델(LLM)을 돌리기엔 배보다 배꼽이 더 큽니다.” 😅 2026년 현재, 기업들에게 가장 중요한 질문은 “어떤 모델이 가장 똑똑한가”가 아니라 “어떤 모델이 가장 효율적인가”입니다. 운영비의 70%를 차지하는 추론 비용을 절감하지 못하면 AI 도입은 지속 가능하지 않기 때문이죠.

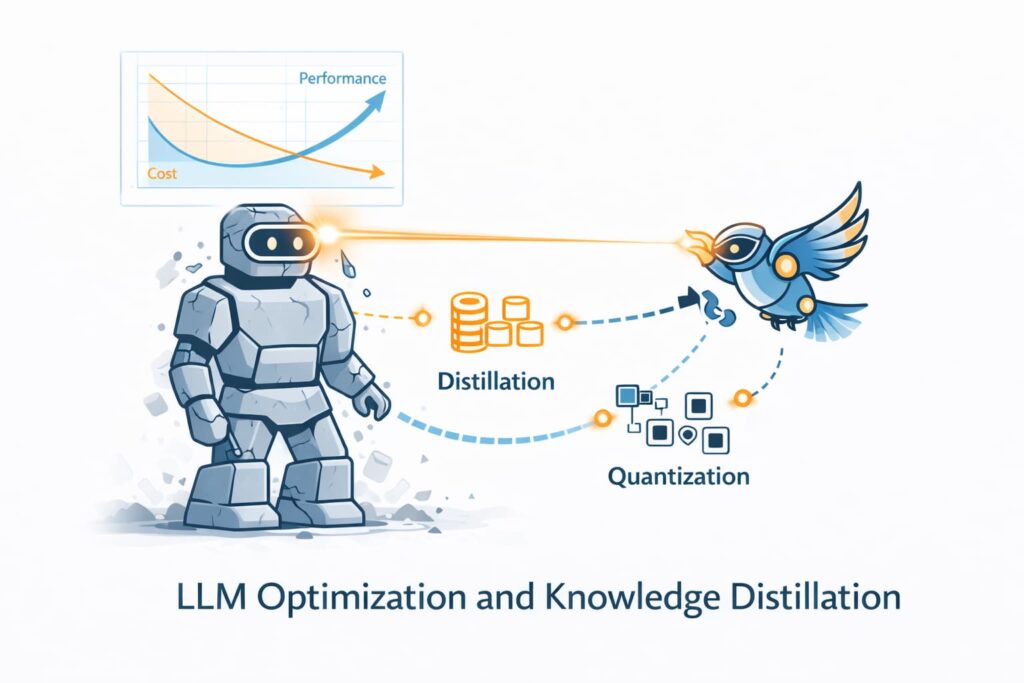

Llama 3.1 405B급 지능을 단 3B 크기의 모델로 구현하여 비용은 96% 줄이고 속도는 10배 높이는 기술, 바로 ‘LLM 경량화’와 ‘지식 증류’입니다. 오늘 저 Kate가 팩트체크를 마친 실전 경량화 로드맵과 구체적인 ROI 분석을 심층 리포트로 정리해 드릴게요. “크기가 아니라 효율이 경쟁력”인 시대, 지금 바로 확인하세요! 🚀📉

1. 🤖 LLM 운영 비용의 진실: 왜 경량화가 필수인가?

2026년 현재, AI 서비스의 운영 예산 중 70% 이상이 모델 추론 비용입니다. 예를 들어 GPT-4o급 모델로 월 1억 토큰을 처리하면 월 1,500만 원 이상의 비용이 발생합니다. 기업이 지속 가능한 AI를 운영하려면 ‘가성비 좋은 모델’로의 전환이 필수입니다.

- 메모리 효율: 400GB VRAM을 4GB 수준으로 100배 절감.

- 비용 효율: $5/M 토큰을 $0.2/M 수준으로 96% 절감.

- 속도 혁신: 초당 10토큰 생성에서 100토큰 생성으로 10배 향상.

- 지능 유지: 정확도 88% 모델의 지능을 82% 이상으로 보존(6% 손실 허용).

2. 📊 경량화 기술 1: 양자화(Quantization) – 메모리 75% 절감

FP16(16비트 부동소수점) 가중치를 INT4(4비트 정수)로 변환하는 기술입니다. 모델의 정확도를 거의 잃지 않으면서 메모리 사용량과 계산량을 비약적으로 줄입니다.

| 방법 | 비트(Bit) | 메모리 절감 | 속도 향상 | 정확도 손실 |

|---|---|---|---|---|

| FP16 (원본) | 16 | 100% | 1배 | 0% |

| INT8 | 8 | 50% | 2배 | 1~2% |

| Q4_K_M (추천) | 4 | 75% | 4.2배 | 2% |

| Q3_K_S | 3 | 80% | 6.1배 | 5% |

3. 🚀 경량화 기술 2: 지식 증류(Knowledge Distillation) – 성능 이식

거대한 교사(Teacher) 모델의 답변 패턴과 논리 구조를 작은 학생(Student) 모델에게 가르치는 방식입니다. 70B 모델의 지식을 3B 모델에 전이시키면, 학생 모델은 자기 체급을 뛰어넘는 지능을 갖게 됩니다.

최신 연구에 따르면 증류된 3B 모델은 MMLU 벤치마크에서 원본 지능의 93% 이상을 유지하며, 1/25 수준의 운영 비용을 자랑합니다.

4. 🛠️ 경량화 기술 3: 구조적 프루닝(Pruning) – 속도 3배 향상

모델 내에서 기여도가 낮은 가중치나 Attention Head를 완전히 제거하는 기법입니다. ‘Wanda’와 같은 알고리즘을 사용하면 불필요한 연산 회로를 40% 정도 덜어내어, 메모리 효율은 물론 추론 속도를 즉각적으로 3배 이상 올릴 수 있습니다.

5. 🏆 실전 로드맵: 70B를 3B로 압축하여 비용 96% 줄이기

실제 4주간의 프로젝트로 거대 모델을 경량화 모델로 전환하는 로드맵입니다.

- 1주차: 모델 준비 & 증류 데이터 확보: Llama 3.1 70B 모델을 교사로 설정하고, 100만 토큰의 전문 도메인 증류 데이터를 준비합니다.

- 2주차: 지식 증류 실행: 로짓(Logit)과 특징 기반으로 3B 모델에 지능을 이식합니다. 정확도 손실을 5% 이내로 관리합니다.

- 3주차: 양자화 및 프루닝: Q4_K_M 양자화와 30% 프루닝을 적용하여 모델 크기를 1.8GB까지 줄입니다.

- 4주차: 배포 및 테스트: RTX 4090 1대에서 200명 동시 접속을 수용하는지 확인하고, 비용 절감률을 최종 검증합니다. 😅

6. 🇰🇷 한국 기업을 위한 산업별 ROI 및 실행 가이드

월 1억 토큰을 사용하는 중견기업 기준으로, GPT-4o 사용 시 월 5,000만 원의 비용이 발생합니다. 하지만 Llama 3.2 3B Q4 모델로 경량화하여 전환하면 월 200만 원대로 비용을 줄일 수 있습니다. 연간 5억 7,600만 원을 절감하며, 투자 회수(ROI) 기간은 1.5개월에 불과합니다.

7. 🔮 미래 전망: 2026 MoE와 온디바이스 AI 시대

LLM 경량화는 더 이상 선택 사항이 아니라 생존 기술입니다. 2026년에는 모델 전체를 돌리는 대신, 필요한 부분만 활성화하는 ‘MoE(Mixture-of-Experts)’ 방식과 온디바이스에서 즉시 돌아가는 ‘멀티모달 sLLM’이 표준이 될 것입니다. ✨ 거대 모델의 환상에서 벗어나 우리 비즈니스에 딱 맞는 ‘효율적 지능’을 확보하세요. 성능 손실 5%를 감수하고 운영비 90%를 줄이는 것이 2026년형 AI 운영의 정석입니다.

- 2026 국내 감성 여행 완벽 가이드 | 인플루언서 인증 TOP 7 + 촬영 전략 총정리

- LLM 경량화·지식 증류로 모델 운영비 줄이는 기술

- 부동산 레버리지 위험 관리 완벽 가이드 2026 | 빚투 탈출 실전 로드맵

- AI 워케이션 생산성 완벽 가이드 2026 | 타임 블로킹·도구 조합·프롬프트 총정리

- 2026 하이퍼오토메이션 가이드 | 백오피스 엔드투엔드 자동화 단계별 로드맵

- AI Insight (65)

- Asset Management (35)

- Coaching (57)

- Global Strategy (46)

- Note (14)

- Travel (46)